- Titre :

- La technologie au service du bien commun, un vœu pieux ?

- Intervenants :

- Benjamin Sonntag - Lucien Castex - Aurélien Devernoix

- Lieu :

- Émission Décryptage RFI

- Date :

- mai 2019

- Durée :

- 19 min 30

- Écouter ou télécharger le podcast

- Licence de la transcription :

- Verbatim

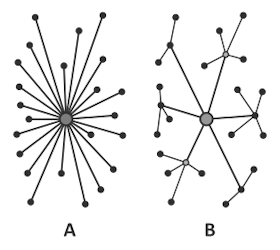

- Illustration :

- Graphical comparison of centralized (A) and decentralized (B) system, Adam Aladdin - Licence Creative Commons Attribution-Share Alike 3.0 Unported

- transcription réalisée par nos soins, fidèle aux propos des intervenants mais rendant le discours fluide.

Les positions exprimées sont celles des personnes qui interviennent et ne rejoignent pas nécessairement celles de l’April, qui ne sera en aucun cas tenue responsable de leurs propos.

Description

La technologie pour faire le bien de tous et toutes, vaste programme discuté, en ce moment même, au palais de l’Elysée où Emmanuel Macron reçoit à la fois des dirigeants politiques et des patrons de géants du numérique. À cette occasion, a été lancé l’appel de Christchurch pour lutter contre la diffusion de contenus haineux en ligne, mais le secteur des nouvelles technologies doit aussi répondre aux questions de plus en plus pressantes autour de la protection des données ou de la remise en cause du droit du travail liée aux modèles économiques des Uber, Amazon et autres Deliveroo.

Transcription

Voix off : Décryptage. Aurélien Devernois.

Voix off de Maurice Lévy : Tech for good but tech for all, donc « la technologie, bien sûr, c’est pour le bien de tous mais c’est aussi pour tout un chacun de manière à ce que tout le monde ait accès à la technologie, parce que c’est ce qui va changer, c’est ce qui va réduire les inégalités ».

Aurélien Devernoix : La déclaration est signée Maurice Lévy cofondateur du salon Vivatech qui ouvre ses portes demain. La technologie pour faire le bien de tous et toutes, vaste programme discuté en ce moment même au palais de l’Élysée où Emmanuel Macron recevait à la fois des dirigeants politiques et des patrons de géants du numérique. À cette occasion, a été lancé l’Appel de Christchurch [1] pour lutter contre la diffusion de contenus haineux en ligne, mais le secteur des nouvelles technologies doit aussi répondre aux questions de plus en plus pressantes autour de la protection des données ou de la remise en cause du droit du travail liée aux modèles économiques des Uber, Amazon et autres Deliveroo.

Vaste programme, on l’a dit, et vaste questionnement philosophique quasiment à décrypter. Cela tombe bien, cette émission est là pour ça.

Et pour évoquer ce dossier avec nous ce soir Benjamin Sonntag, cofondateur de La Quadrature du Net [2], association de défense des droits et libertés des citoyens sur Internet. Bonsoir.

Benjamin Sonntag : Bonsoir.

Aurélien Devernoix : Et Lucien Castex, chercheur à l’Université Sorbonne Nouvelle et secrétaire général de l’Internet Society France.

Lucien Castex : Bonsoir.

Aurélien Devernoix : Cet Appel de Christchurch a été lancé aujourd’hui. On rappelle le contexte : la diffusion en direct, sur les réseaux sociaux, des attentats contre trois mosquées de la ville néo-zélandaise en mars dernier et les difficultés rencontrées pour empêcher cette vidéo de se maintenir en ligne. Étaient présents notamment à l’Élysée, aux côtés d’Emmanuel Macron, la Première ministre néo-zélandaise, Jacinda Ardern, et d’autres chefs d’États et de gouvernements mais aussi des représentants de fournisseurs d’accès à Internet qui se sont d’ailleurs engagés à prévenir le téléchargement de contenus terroristes. Benjamin Sonntag, Lucien Castex, cet engagement est-il réalisable. Qui commence ?

Benjamin Sonntag : C’est un vrai problème pour les fournisseurs d’accès à Internet, Orange, Free, SFR, tout ça, de pouvoir faire quoi que ce soit avec nos tuyaux, parce que c’est censé n’être que des tuyaux. Pour pouvoir bloquer quoi que ce soit il faut qu’ils regardent ce qu’on fait. C’est illégal en droit français. Déjà il va falloir qu’ils fassent quelque chose qui est illégal, d’entrée de jeu.

Aurélien Devernoix : Il y a déjà un paradoxe.

Benjamin Sonntag : Déjà il y a un paradoxe sur les fournisseurs d’accès à Internet qui ne sont pas censés voir ce qu’on fait sur Internet de la même façon que votre bibliothécaire n’est pas censé de garder la liste des bouquins que vous avez lus. C’est la vie privée de base, en fait, ou la poste n’est pas censée ouvrir les colis.

Aurélien Devernoix : Comment on fait justement, Lucien Castex ?

Lucien Castex : Effectivement, sur cet Appel de Christchurch, il y a un certain nombre de questions qui se posent et notamment les types d’outils qui peuvent être utilisés. Parmi les outils, l’un des outils qui revient le plus souvent c’est le filtrage. Le filtrage des contenus qui seraient donc identifiés comme de nature terroriste. La problématique qu’il y a c’est comment est-ce que l’on filtre ? Le plus souvent ça pose des questions d’algorithmes, d’intelligence artificielle, ce qui pose également des questions de biais, ce qui pose également des questions de contrôle et de transparence de ces algorithmes. Il y a un risque de sur-blocage et c’est un risque qui peut potentiellement mettre en péril d’autres droits fondamentaux, premier desquels la liberté d’expression.

Benjamin Sonntag : Ce n’est pas du tout un risque théorique. On l’a constaté des centaines de fois sur YouTube, je parle de YouTube parce qu’on le connaît bien, typiquement des vidéos qui se sont retrouvées être bloquées. Le dernier exemple, je vous le donne en mille, c’était une vidéo qu’un citoyen avait faite, qu’il avait publiée. Arte en a repris un bout pour un de leurs reportages et YouTube a ensuite bloqué la vidéo en disant que ça venait d’un reportage d’Arte qui n’avait pas cité le monsieur. On a déjà des loops, des boucles comme ça d’atteintes aux droits qui ont lieu tous les jours.

Par contre, à l’inverse, tous les jours on a des citoyens qui signalent des contenus, je ne parle pas forcément de terrorisme, je parle déjà de contenus haineux sur Internet, d’appels au meurtre, d’appels à la haine, des choses qui sont manifestement illégales en droit français et les Facebook, les YouTube n’agissent quasiment jamais. Pourquoi ils n’agissent jamais ? Parce que c’est leur fonds de commerce, leur business c’est notre attention. Ils nous vendent de la publicité. On n’est pas leurs clients, on est leurs petits cochons vendus, la viande qui est vendue aux publicitaires. Donc business modèle de ces sociétés c’est de vendre notre attention. S’ils enlèvent ces contenus haineux qui, en général, font pas mal de public eh bien ils ont un problème de business modèle. Donc on a une vraie question avec toute leur de volonté, tout d’un coup, d’aider les États. Depuis quand les boîtes privées sont les amies des États pour bloquer ? On est très, très méfiants à La Quadrature !

Aurélien Devernoix : Dans ce cas-là, dans ce cas précis, parce que c’est vrai qu’il y avait une certaine pression qui s’était exercée sur Facebook, sur YouTube lors de ces attentats en Nouvelle-Zélande, on n’est pas vraiment dans la tech for good, c’est-à-dire que ce n’est pas vraiment pour le bien commun, c’est plutôt de la « tech communication de crise » pour ces entreprises qui essaient de limiter les dégâts pour leurs revenus ?

Benjamin Sonntag : Complètement. Pour Google dont le business modèle c’est le capitalisme de la surveillance, c’est une espèce d’damage control , essayer de tenter de donner une belle figure, dire qu’ils veulent faire le bien, etc. Les gens qui analysent de près ce que fait Google au quotidien pour les citoyens ! Ils ne font rien. Ils ne font que vendre de la publicité. C’est leur business. Point. Il n’y a rien pour les défendre.

Aurélien Devernoix : Lucien Castex c’est du tech washing ?

Lucien Castex : Je dirais, peut-être pour compléter sur cet aspect, qu’il y a toujours un risque, dès lors que l’on veut réguler, de régulation précipitée. Il y a un risque, le filtrage que je mentionnais tout à l’heure, mais effectivement, il y a potentiellement un risque de déléguer des pans de souveraineté numérique. On voit la question qui se pose notamment dans la proposition de loi de lutte contre les contenus haineux en ligne. Est-ce que l’on doit laisser un intermédiaire privé, une plateforme par exemple, réguler elle-même les contenus qui seraient de caractère haineux, qui seraient manifestement illicites, de déterminer que de tels contenus le seraient ? C’est le rôle du juge. Là encore il y a un besoin de transparence, il y a un besoin d’auditabilité. Quelque part, c’est le souhait de légitimité de transparence des plateformes.

Aurélien Devernoix : Est-ce que justement ce problème, ce paradoxe que vous avez soulevé tout de suite, ce n’est pas lié à l’essence même d’un Facebook, d’un Google, d’un YouTube, qui se sont créés sur une logique, on va dire un discours originel assez libertaire – tout le monde peut aller sur Internet et dire ce qu’il veut – basé sur la liberté d’expression et qui, depuis s’est transformé en machine qui rapporte beaucoup d’argent. Du coup, couper l’un coupe l’autre.

Benjamin Sonntag : C’est le problème des monopoles. Aujourd’hui YouTube est un quasi monopole sur la vidéo en ligne, Facebook est un quasi monopole sur les réseaux sociaux ; Twitter, lui, partage un petit bout de gâteau mais ce n’est vraiment rien. Ces sociétés ont des monopoles de fait, ce qu’on appelle des effets de réseau. En fait, si tous vos amis sont sur Facebook, vous n’allez pas aller sur, je ne sais pas, Diaspora [3] qui est une alternative décentralisée ; si tous vos amis sont sur Twitter, vous n’allez pas aller sur Mastodon [4] qui est une autre alternative décentralisée. À La Quadrature on invite à l’utilisation de ces outils décentralisés qui évitent, justement, de se mettre entre les mains de grandes sociétés. Au moins, si vous avez des petites communautés autonomes, qui peuvent parler entre elles malgré tout évidemment, sans problème, vous avez une espèce d’autonomie, une espèce d’indépendance de ces géants. On n’a pas l’impression d’être, comme je vous le disais tout à l’heure, un petit cochon dans un hangar.

Aurélien Devernoix : Est-ce que, finalement, c’est complètement illusoire de se dire que ces entreprises — les GAFAM ou d’autres d’ailleurs —qu’elles peuvent participer, grâce à leurs outils technologiques, grâce à ce qu’elles développent, à la participation au bien commun ?

Lucien Castex : C’est vrai que c’est une question difficile. On va dire, une grande entreprise de l’Internet peut collaborer avec l’État, peut collaborer avec des organisations internationales, avec les parties prenantes de l’Internet. La question qui va se poser c’est : est-ce que cette collaboration est inclusive ? Une des réserves qu’avait l’Internet Society au niveau de l’Appel de Christchurch ou d’autres initiatives, quand bien même, parfois, allaient-elles dans le bon sens, c’est le fait qu’elles n’étaient pas suffisamment inclusives quant aux parties prenantes qui étaient mobilisées. Par exemple, le fait de demander à la société civile ou à la communauté technique de s’asseoir à la table et de discuter directement avec ces acteurs, tout autant qu’avec les gouvernements, sur comment faire, justement, pour limiter la diffusion de tels contenus, l’accélération de ces contenus, le fait qu’ils soient trop diffusés, c’est cette inclusivité et, bien sûr, je le répète encore, cette transparence qui rend, quelque part, à la fois la régulation et une possibilité de coopération possibles.

Aurélien Devernoix : Mais alors, ce qui est paradoxal également, c’est qu’il y a quand même beaucoup de ces grosses sociétés qui ont signé cet appel aujourd’hui à Paris, qui, finalement, doivent y trouver un intérêt et que, dans le même temps, il y a d’autres entreprises, par exemple les réseaux sociaux chinois, qui ont refusé de signer cet Appel et le pays qui est le pays d’origine des GAFAM, les États-Unis, qui refuse également de signer cet Appel. Pourquoi, finalement, parce qu’on a l’impression que ça arrange tout le monde ?

Benjamin Sonntag : Déjà les pays ont leur géopolitique à eux, ils ont leur façon de procéder à eux. Les entreprises, comme on le disait tout à l’heure, elles sont vraiment dans le contrôle de la qualité de leur image. Il faut que Google apparaisse comme étant un gentil ; il faut que Facebook apparaisse comme étant un gentil. Ce qu’ils font derrière peut n’avoir rien à voir, ils auront donné patte blanche, médiatique, etc. Le gouvernement fait pareil très régulièrement. Moi j’entends très régulièrement : « Ah, il va y avoir un projet de loi pour ceci, pour cela ». On se rend compte, deux ans après, que le projet de loi a à peine fait une passe et demie au Sénat et à l’Assemblée, il n’est pas arrivé dans le droit.

Nous ce qu’on dit, c’est le problème de ces géants du numérique, c’est que le droit français ne s’applique pas pour eux. Ça fait plus d’an que La Quadrature a déposé des plaintes contre Facebook, Google, pour le non-respect des données personnelles, le dossier a à peine avancé. Donc ça ne sert à rien d’essayer de faire des vœux pieux, de montrer des jolis systèmes de filtrage avec des IA, avec tout ce qu’ils veulent, s’ils ne respectent pas déjà la base du droit qui est de respecter nos données personnelles. Tant qu’on n’aura pas armé de crocs, sévèrement armé la CNIL, tant qu’on n’aura pas sévèrement armé les tribunaux pour lutter contre les abus de ces grandes sociétés, elles feront du tech washing, elles donneront l’impression d’être toutes gentilles et puis elles ne feront rien derrière parce qu’il n’y a pas de punition. Tant qu’il n’y a pas de punition, une société elle fait ce qu’elle a dans ses gènes : Facebook, Google, leurs gènes c’est la vente de publicité et l’exploitation de nos données personnelles. Il n’y aura rien d’autre. On ne s’attend à rien.

Aurélien Devernoix : Justement est-ce qu’il n’y a pas, malgré tout, une part stratégique de la décision des États-Unis en tant que pays de ne pas signer, justement pour se permettre de garder une marge de manœuvre en cas de décision en Europe de réguler plus strictement ce type de choses et notamment les données personnelles ? Ça a déjà été le cas puisqu’on a réformé avec le RGPD [5].

Benjamin Sonntag : Les États-Unis sont moins faux-jetons que nous quelque part, ils sont plus francs du collier, ils ont la liberté d’expression de manière quasi illimitée dans ce pays, ils l’assument, voilà, c’est tout.

Aurélien Devernoix : Oui, mais malgré tout, au niveau de l’Union européenne, il y a eu une réforme sur les données personnelles et le fait qu’elles ne sont pas censées partir de manière totalement inconsidérée vers…

Benjamin Sonntag : Bien sûr. Mais pour l’instant la CNIL ne fait pas grand-chose. Pour l’instant c’est lettre morte, Alors elles ont bien été enregistrées, ça s’instruit tranquillement, sauf que la plupart de ces affaires vont se retrouver à la CNIL irlandaise qui est clairement pieds et poings liés parce que, en Irlande, ces sociétés font de la défiscalisation en masse.

Aurélien Devernoix : Qui accueille les sièges européens d’un certain nombre de grandes entreprises.

Benjamin Sonntag : Donc qui n’a aucun intérêt à faire des amendes de 4 % de leur chiffre d’affaires à des Google ou à des Facebook. On sent bien qu’on est dans un jeu géopolitique où la pression est énorme et où faire des déclarations de Christchurch avec 24 pays qui n’engagent personne ça ne sert à rien ! À La Quadrature on invite vraiment à ce que la CNIL se serve de ses pouvoirs régaliens, les CNIL européennes se servent de leurs pouvoirs, pour aller demander à ces sociétés de respecter le droit. Quand elles respecteront nos données personnelles on parlera éventuellement de ce que sont les contenus qu’il y a chez eux. Et encore, nous ça ne nous intéresse pas trop, on préfère favoriser des alternatives décentralisées, comme ça on améliore l’écosystème numérique et on évite de dépendre de ces grandes plates-formes.

Aurélien Devernoix : J’entends bien la nécessité d’éviter les situations de monopole, malgré tout on va revenir à notre sujet central, la question du bien commun. Lucien Castex, on peut finalement tirer un bien commun de ces rapports de force, de ces tentatives, on va dire, de certains pays, notamment en Europe, d’essayer de réguler un petit peu tout ça ?

Lucien Castex : Effectivement le RGPD qui est en vigueur, qui est entré en application, permet quelque part de responsabiliser les acteurs. C’est vrai qu’il y a des questions au niveau de son application. Il y a souvent, qui est rappelée, l’extraterritorialité de ce texte. Il y a également un certain nombre de questions qui se posent. J’en cite une très rapidement, celle de l’intérêt légitime. On dit que le consentement est la base principale du RGPD, c’est vrai. Mais il y a également l’intérêt légitime qui peut servir à justifier un traitement de données personnelles.

La définition de l’intérêt légitime est parfois un peu lâche, un peu générale, et ne permet pas, dans certains cas, d’appréhender ce qu’est vraiment le seuil qui permet de définir ce qu’est justement cet intérêt légitime.

Plus largement, il y a une question de confiance. Et cette question de confiance c’est de dire que les utilisateurs, s’ils ne se sentent pas en confiance avec le numérique, pour revenir à votre question de la technologie pour le bien commun, s’ils ne se sentent pas en confiance avec le numérique est-ce qu’ils ne vont pas changer leurs pratiques ? Est-ce qu’il y a possibilité de changer ses pratiques, considérant justement que tel ou tel outil, que ce soit une plateforme ou que ce soit par exemple un objet connecté, ne soit pas suffisamment sûr au regard de questions de cybersécurité, de protection de la vie privée ou des données personnelles ?

Aurélien Devernoix : Mais est-ce que ça, justement, ça ne passe pas en amont par tout un travail vraiment d’éducation des consommateurs de ces entreprises de nouvelles technologies pour être conscients, être mis à jour, finalement, sur ce qui est risqué et sur ce qui l’est moins ?

Benjamin Sonntag : Ça se joue sur tous les plans, clairement. À La Quadrature, par exemple, on est très technophiles et on se rend compte que de plus en plus, dans la liste de nos membres, quand on en parle entre nous, on est de moins en moins fans du dernier gadget. Pour plein de raisons. La première c’est qu’on sait que ce gadget ne va pas être mis à jour dans les six mois et qu’on va se retrouver avec nos données personnelles tout nu sur Internet, c’est quand même un petit peu embêtant ! Deuxième chose c’est que ces gadgets, souvent, écologiquement, c’est un désastre. Ça nécessite des terres rares qui sont récoltés dans des pays genre pays d’Afrique, Chine, qui sont récoltés dans des conditions de travail absolument effroyables, des conditions écologiques absolument effroyables. Il y a une pérennité zéro. On sait que dans 20 ans on aura de plus en plus de mal à trouver ces matériaux, voire déjà peu aujourd’hui. Donc il n’y a rien pour plaire ! Et on ajoute à ça, ces sociétés : il y a très peu de régulation et il y a très peu de responsabilité quand elles font n’importe quoi avec nos données. On le voyait tout à l’heure, il y a très peu d’application du RGPD. Donc tant que les sociétés n’ont pas vu, même d’autres boîtes qu’elles, se prendre des coups parce qu’elles ont été trop loin du respect du droit, on n’arrivera pas à ce qu’elles aient peur du droit et qu’elles aient envie de le respecter. Il y a une histoire de rapport de force et d’exemplarité. Et aujourd’hui le rapport de force est clairement déséquilibré.

Aurélien Devernoix : Si les grandes entreprises ne sont pas exemplaires, forcément les startups qui se montent, etc., vont avoir tendance à ne pas l’être non plus !

Benjamin Sonntag : Tout à fait ! D’ailleurs l’esprit startup lui-même pose problème. Si on va à la racine du débat, l’esprit startup c’est quoi ? La plupart du temps c’est quelques fondateurs qui espèrent soit faire une grosse boîte, tout d’un coup devenir une licorne, une boîte qui est valorisée un milliard d’euros c’est-à-dire faire plein de blé ou se faire racheter pour des sommes équivalentes. Finalement le seul but de ces gens, quand on interroge la plupart des startupers, c’est essayer de faire de l’argent, ce n’est pas du tout d’avoir des gens avec qui travailler dans de bonnes conditions, avoir des projets qui auront du sens. C’est rare qu’on ait cet esprit-là.

Aurélien Devernoix : Justement on va enchaîner là-dessus, sur la question de l’éthique des entreprises. Ça va peut-être dériver un petit peu politiquement mais finalement vous parliez de licornes. Quand on est une très grande entreprise, prenons par exemple le cas de Uber ou, je ne sais pas, de Tesla qui est peut-être moins dans les nouvelles technologies mais passons, on est valorisé à des milliards de dollars, on ne fait pas forcément de bénéfice, donc on est totalement dépendant des actionnaires, comment on peut, finalement, faire preuve d’éthique ou être dans une politique de développement de son éthique quand tout peut s’arrêter du jour au lendemain parce que les actionnaires ne sont pas contents ?

Lucien Castex : Il y a clairement une difficulté au niveau du modèle économique. Le modèle économique d’un certain nombre de sociétés, d’un certain nombre de startups, pose des difficultés que ce soit au niveau des plateformes qui, dans certains cas, interrogent on va dire le droit de la concurrence ou un certain nombre de nos législations. Il y a également un problème de survie de ces entreprises, ce qui, bien entendu, pose des questions en termes d’éthique. Que faire, justement, pour rendre viable un modèle économique, pour le rendre pérenne alors que dans certains cas la valorisation n’est pas assise sur des bases solides ? La question de l’éthique c’est aussi de définir quels sont les principes que l’on veut respecter. S’il y a des principes communs est-ce qu’on peut avoir un socle éthique que l’on peut appliquer dans le numérique, que l’on ferait respecter et qui, justement, aille dans le sens d’un renforcement de la confiance des utilisateurs ?

Aurélien Devernoix : Mais alors justement comment on fait ça ? Comment ça peut se mettre en place ? On dit tech for good, comment mettre en place, finalement, quelque chose qui soit relativement équilibré ?

Benjamin Sonntag : Nous on appelle ça la décentralisation, le chiffrement de bout en bout, le logiciel libre. Ce sont des points qui ont l’air assez techniques comme ça, mais le fait de ne plus dépendre d’une grosse société pour sa communication, c’est extrêmement important. Le fait que nos communications soient chiffrées, c’est-à-dire qu’elles ne soient pas écoutables, qu’on ne puisse pas les écouter quand on s’appelle Facebook ou Google c’est très important. Le fait que le logiciel qu’on utilise soit libre, c’est-à-dire que sa recette de cuisine est lisible, pas forcément par vous qui n’êtes pas technicien, mais vous pouvez demander à votre copain geek d’y jeter un œil ou aller voir des gens qui ont fait l’audit pour vous dire c’est bon, c’est de confiance. Quand il n’y a pas ça, quand il n’y a pas au moins ces trois facteurs-là, il ne peut pas y avoir confiance.

Quand on parle d’éthique des entreprises, la responsabilité sociale des entreprises ce n’est pas nouveau, ça date, de mémoire, des années 60-70. À l’époque on aurait dit quoi ? Est-ce que vous pouvez avoir confiance en Total, en General Motors, en, je ne sais pas, British Petroleum ou des grandes sociétés de l’époque ? À priori non. Il fallait de la régulation. Par exemple, pour tout ce qui est écologie, c’est pas la régulation des États la plus stricte qu’on a réussi à obtenir, des fois aux forceps vraiment des petites choses sur le respect ou sur le code du travail. Je pense que les nouvelles technologies ne font pas exception. Ce qui est exceptionnel dans ces nouvelles technologies c’est le côté immédiatement international. Uber, tout de suite il travaille au niveau international. Ça n’empêche pas qu’on puisse faire respecter le droit du travail français en France, le droit du travail allemand en Allemagne, le droit du travail européen en Europe, donc je pense qu’il faut juste s’armer politiquement et être capable de faire des bras de fer avec le grand frère américain.

Aurélien Devernoix : Lucien Castex ?

Lucien Castex : J’ajouterais qu’il y a effectivement une forte importance de l’éducation. Éduquer les citoyens, les utilisateurs au sens large, déjà pour qu’ils comprennent comment Internet fonctionne, où sont les différents points d’achoppement et dès lors, en comprenant comment ça fonctionne, il y a une capacité à se responsabiliser. On parle souvent, on en parlait tout à l’heure, on a parlé des filtres, mais est-ce que ce n’est pas, quelque part, apprendre l’esprit critique ? Être capable soi-même d’évaluer un contenu ?

Aurélien Devernoix : Merci beaucoup Lucien Castex chercheur à l’université Sorbonne Nouvelle et secrétaire général de l’Internet Society France. Merci à Benjamin Sonntag cofondateur de La Quadrature du Net.

Cette émission a été préparée par Éléonore Krainik. Excellente journée à l’écoute de RFI.